Неизвестность всегда пугает. Всякий раз, когда человечество стояло на пороге новых открытий, инновационных разработок или технических революций, люди испытывали страх: что принесут эти радикальные изменения? Так было и в эпоху перехода от лошадей к автомобилям, и на заре развития электроэнергии, и во времена развития всемирной паутины Интернет.

Одни в переменах видели перспективы, другие – угрозу. Сегодня, когда техника с каждым годом становится все более совершенной, наше будущее снова выглядит туманным: каким будет искусственный интеллект через 10-50 лет, принесут ли эти разработки пользу, или станут главным врагом человека?

Почему развитие искусственного интеллекта пугает?

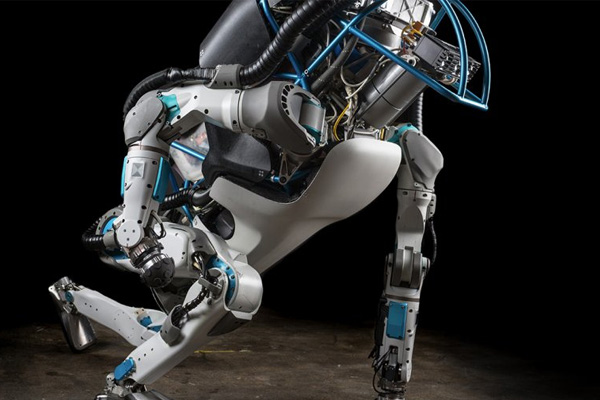

Еще несколько лет назад разработки в сфере ИИ были привилегией исключительно крупных компаний (Google, Microsoft, Amazon), а уже сегодня над проектами могут трудиться даже небольшие стартапы без серьезного финансирования. Это стало возможным благодаря облачным технологиям. Доступ к такой платформе, как Azure (Microsoft), и новинкам Cloud AutoML(Google), Gluon (библиотека глубокого обучения, созданная Microsoft и Amazon) позволят активнее внедрять технологии в энергетику, промышленность, медицину, военное дело. Создатели Gluon уверены, что технология позволит создавать нейросети также просто, как сегодня создаются простейшие приложения для смартфонов.

Однако, в этой простоте и кроется угроза (об этом говорили и Хокинг, Маск и другие). Многие исследователи считают, что пройдет совсем немного времени до того момента, как ИИ научится самосовершенствоваться, а также использовать накопленный опыт и знания, что сделает его сверх развитым. Краткосрочный эффект использования ИИ зависит от того, кто им управляет, а долгосрочный — от того, будет ли возможность им управлять. Такие устройства смогут самостоятельно анализировать ситуации и принимать необходимые решения, и возможно, эти решения будут не в пользу человека.

Кроме того, получается, что разработки ведутся практически бесконтрольно, а значит, любой желающий сможет сконструировать устройство, которое может нанести вред одному человеку или целым странам. В Организации Объединенных Наций уже настаивают на законодательном регулировании создания разработок с ИИ, которые могут использоваться в военных конфликтах.

Ученые увидели угрозу искусственного интеллекта социального характера. Повсеместное использование техники с ИИ станет причиной того, что люди перестанут принимать решения самостоятельно и будут полагаться на решение машины. Люди станут слишком зависимы от устройств. Умные устройства смогут манипулировать мнением и решением своих владельцев.

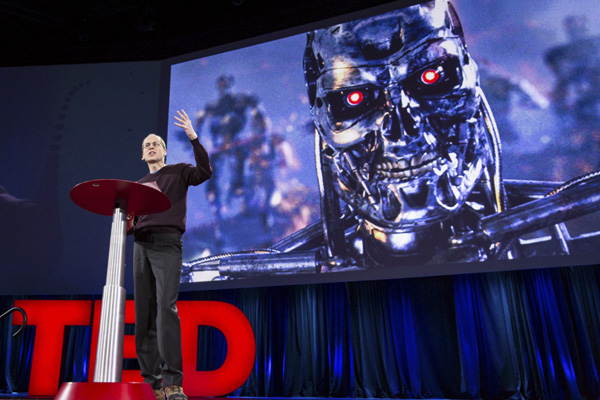

Ник Бостром (автор книги «Superintellingence: Paths, Dangers, Strategies») говорит о невозможности войны человека и машин, как невозможны столкновения человека и обезьян или с другими животными. Это бессмысленно, и если уж человечество допустит развитие такого сценария, то исход противостояния заранее известен.

По мнению шведского философа эволюция искусственного интеллекта будет проходить с человеческой эволюцией. От слепой эволюции, в которой мы находимся сейчас, до осознанной. В будущем хозяином планеты будет сверхразум, мы неумолимо движемся в этом направлении, единственным вопросом будет ли это сверхразум, построенный на основе человеческого, или первенство достанется искусственно созданному устройству.

Кроме того, не все ученые, исследователи и научные деятели поддерживают теорию «восстания машин». По их мнению, угрозы искусственного интеллекта, о которых так много сегодня говорится, это нечто мифическое, а те, кто активно продвигает идею угрозы преследуют собственные цели: продвижение собственных идей, попытки отвлечь людей от действительно насущных проблем. Уже сейчас мы активно используем продукты ИИ: голосовые помощники, умные дома, беспилотные автомобили и много другое. И в дальнейшем это будет просто доводиться до совершенства. Если человек не будет ставить перед устройством цель «нанести ущерб», то и сама машина не будет генерировать подобных задач. А на ваш взгляд, какое нас ждет будущее?