Многие авторы научной фантастики считают, что однажды «разумные» роботы могут физически и умственно превзойти человека. Они также часто задаются вопросом, что произойдет, если эти роботы просто решат, что люди им не нужны. Чтобы облегчить эту проблему, в прошлом столетии Айзек Азимов предложил ее решение в виде определенных законов. Какие три закона робототехники придумал великий писатель, узнайте в нашей статье.

Краткая история о человеке, который создал законы

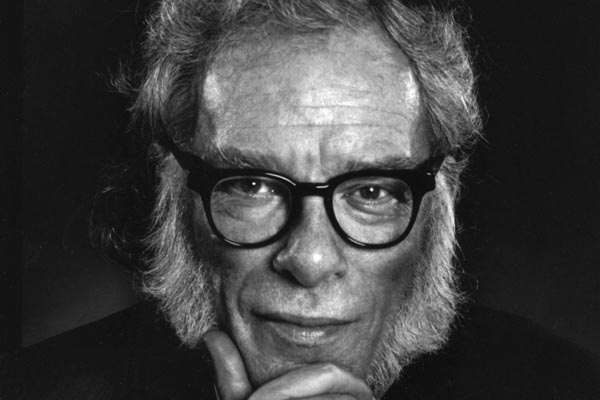

Айзек Азимов родился 2 января 1920 года в России. Он был американским писателем, специализирующимся на жанре научной фантастики. Азимов — это признанный во всем мире писатель-фантаст, один из трех великих мастеров в этой сфере. Являясь профессором биохимии в Бостонском университете, Исаак Азимов имел более 500 опубликованных томов в дополнение к 90 000 писем, открыток и других научных книг.

Он был сыном Иуды и Анны Азимовых, которые иммигрировали в Соединенные Штаты, когда Исааку было три года. В детстве Айзек исследовал все библиотеки в пределах своей досягаемости, его можно было смело назвать «книжным червем». Азимов окончил Колумбийский университет в 1939 году со степенью по химии, а затем получил докторскую степень в том же университете в 1948 году. Позднее он принял предложение вести лекции в Бостонском университете, где стал доцентом биохимии в 1955 году.

Литературная карьера Азимова началась, когда начали публиковаться его работы в научно-фантастических журналах в 1939 году. «Ночная осень», написанная в 1941 году, оказалась лестницей к литературному успеху. История основана на планете, где ночь появляется только один раз в каждые 2049 лет. До сих пор она считается лучшим научно-фантастическим рассказом. Его первая книга «Галька в небесах» была опубликована в 1950 году. Самым известным сборником романов является трилогия «Фонд. Фонд и империя. Второй фонд» (1951-1953). Эта космическая трилогия повествует о футуристической галактической империи. «Я, Робот» (1950), который также сняли в 2004 году, является еще одной блестящей работой Азимова, которая фокусируется на разработке правил и этики для искусственно-интеллектуальных машин. Некоторые другие известные художественные произведения Исаака Азимова: «Звезды», такие как «Пыль» (1951), «Потоки космоса» (1952), «Стальные пещеры» (1954), «Обнаженное солнце» (1957), «Достаточно места для комнаты» (1957) и т.д.

Азимов также был автором многих нехудожественных произведений, первым из которых было «Химия жизни» (1954). Некоторые другие его научные труды включают «Внутри атома» (1956), «Мир азота» (1958), «Жизнь и энергия» (1962), «Мозг человека» (1964), «Нейтрино» (1966), «Наука, числа и я» ( 1968), «Наш мир в космосе» (1974) и «Виды Вселенной» (1981). Кроме того, в дополнение к написанию двух автобиографий Азимов также опубликовал ежеквартальный научно-фантастический журнал Исаака Азимова, который был основан журналами Дэвиса. Вклад Исаака Азимова в научную литературу был отмечен такими почетными наградами, как Гюго, Туманность и другими.

Азимов был женат дважды. Его первая жена, на которой он женился в 1942 году, Гертруда Блугерман родила ему двоих детей. Они расстались в 1970 году, развелись в 1973 году. В том же году он сошелся с Джанет Опал Джеппсон, писателем и психоаналитиком. Азимов скончался 6 апреля 1992 года в Нью-Йорке из-за почечной недостаточности. Однако через десять лет после смерти его жена Джанет рассказала, что у него был СПИД. ВИЧ-инфекцией он случайно заразился во время операции шунтирования.

Какие законы робототехники предложил Азимов?

«Три закона робототехники» дебютировали в истории Исаака Азимова под названием «Обход», впервые опубликованной в мартовском выпуске журнала «Потрясающая научная фантастика» 1942 года под редакцией Джона В. Кэмпбелла.

Сейчас мы детально рассмотрим 3 закона робототехники Азимова, а также расскажем, что о них думают некоторые из современных ученых.

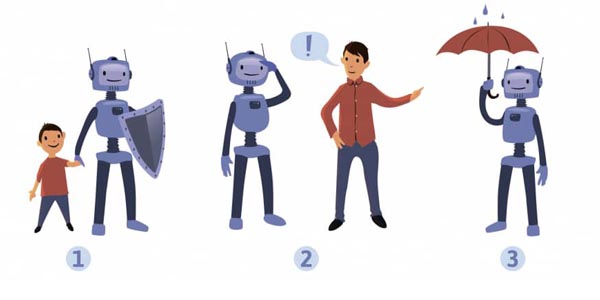

1 закон: робот не может ранить человека или причинять вред человеку своим бездействием.

Когда мы рассматриваем угрозу человечеству, на что ссылается первый закон робототехники Исаака Азимова, наши мысли быстро перерастают из несчастных случаев на производстве в совершенно преднамеренные сценарии сражений. Применим ли такой закон?

25 января 1979 года автомобильный работник Роберт Уильямс получил прискорбную славу, став первым человеком, которого убил робот на заводе Ford в Мичигане. Два года спустя робот на заводе в Кавасаки толкнул рабочего Кенджи Урада в шлифовальный станок с гидравлическим рычагом. Такие несчастные случаи бывают редко, но с годами роботы раздавливали, били и даже обливали людей расплавленным алюминием. Ранние модели, такие как Unimate, не оборудовались для того, чтобы останавливать свои движения в опасных условиях, и не могли ощущать присутствие человека в пределах своего рабочего диапазона.

Многие современные роботы способны принимать элементарные решения о безопасности. Датчики движения, мягкая прокладка, устранение «точки защемления» в механике, камеры, протоколы предотвращения столкновений и новые сферы поведенческого программирования открывают перспективы для роботов, способных взаимодействовать с людьми.

2 закон: робот должен подчиняться приказам, данным ему людьми, за исключением случаев, когда такие приказы вступают в противоречие с Первым законом.

В 1950 году пионер вычислительной техники Алан Тьюринг предположил, что если у вас разговор с машинным интеллектом, и вы не можете определить разницу между его реакцией и тем, что вы ожидаете от человека, то машина, вероятно, так же реагирует, как и вы. В июне 2014 года Школа системотехники Университета Рединга организовала тест Тьюринга в Королевском обществе в Лондоне. Владимир Веселов был частью команды, которая разработала «Евгения Густмана», сверхъестественную пародию на 13-летнего украинского мальчика из Одессы. Он одурачил 11 из 30 судей, по крайней мере, на короткое время, необходимое для проведения теста.

Веселов не питает иллюзий по поводу состояния игры. «Мы не можем говорить об историческом шаге в развитии искусственного интеллекта», — предупреждает он. «Этот робот как литературное и психологическое творение, которое прошло испытание». Дело в том, что роботам не нужно проходить тест Тьюринга. Они уже становятся «достаточно хорошими» в мимике, чтобы заменить людей в широком спектре задач.

Если текущие тенденции еще не преодолены, вторжение компьютеров, роботов и «экспертных систем» на рабочее место ставит Второй закон в противоречие с Первым. Роботы очень хорошо выполняют приказы, которые они отдают, и можно утверждать, что это «наносит вред» людям. Причиняет ущерб не физическая травма, а экономическая составляющая.

В 1933 году экономист Джон Мейнард Кейнс предсказал, что технологии, призванные захватить нашу работу, «опережают темпы, с которыми мы можем найти новые способы использования человеческого труда». Ровно через 80 лет междисциплинарная группа в Оксфордском университете подготовила доклад под названием «Будущее занятости: насколько восприимчивы рабочие места к компьютеризации?». Было сделано поразительное заключение, что 47% всех рабочих мест в Америке находятся под угрозой.

3 закон: робот должен защищать свое существование, если такая защита не противоречит Первому или Второму законам.

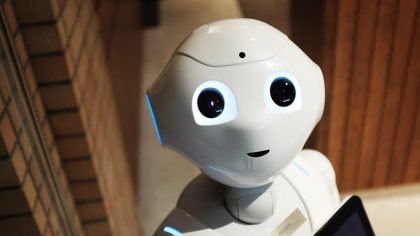

Может ли робот защитить свое существование, если он не знает, что он существует? Машины могут казаться людьми и даже способны к очевидным социальным взаимодействиям, но могут ли они когда-нибудь стать самосознательными?

Робин Мерфи и Дэвид Вудс, авторы книги «Помимо Азимова», удивлены тем, как мало внимания уделяется самосохранению робота. «Поскольку роботы стоят дорого, можно предположить, что у дизайнеров будет мотивация включить какую-либо форму Третьего закона в свои продукты», — говорят они. «У многих коммерческих роботов нет средств для защиты инвестиций их владельцев». Любое применение Третьего закона в современных условиях будет направлено на защиту людей от финансового и физического ущерба.

Противоречия в 3 законах робототехники

Частично противоречия в законах мы рассмотрели в предыдущем пункте. А теперь поговорим о них детальнее.

Законы Азимова становятся более шаткими при рассмотрении вопроса о разработке управляемых человеком военных беспилотников, предназначенных для убийства других людей издалека. Как это ни парадоксально, если контролирующий человек направляет робота, чтобы спасти жизни своих сограждан, убивая нападающих на них людей, можно сказать, что он следует как первому закону Азимова, так и нарушает его.

Кроме того, если беспилотник направлен человеком, можно утверждать, что это вина человека в гибели людей в боевых ситуациях, а не беспилотника. Действительно, армии, оснащенные беспилотниками, значительно уменьшат количество человеческих жертв в целом. Возможно, лучше использовать роботов, а не людей в качестве пушечного мяса.

На другом конце шкалы законы Азимова подходят, если обеспечение безопасности пожилого человека является основной целью робота. Но часто робототехника вписывается в ряд «вспомогательных» технологий, которые помогают пожилым людям обрести независимость. Это означает, что они могут принимать собственные решения, в том числе те, которые могут привести к причинению вреда себе, например, в результате падения. Робот, позволяющий своему человеку принимать независимые решения, которые привели к травме в результате падения, нарушал бы Первый Закон из-за бездействия.

Однако Сорелл утверждает, что человеческая автономия должна соблюдаться как другими животными, так и роботами. Необходимо также уважать пожилых людей, которые делают выбор, гарантирующий их дальнейшую независимую жизнь, но могут подвергнуть их риску получения травмы.

Новые законы робототехники

Ученый-компьютерщик Робин Мерфи из Техасского университета A&M и Дэвид Вудс, профессор когнитивных систем в Университете штата Огайо, пересмотрели три закона Азимова, пытаясь исправить неясности в выражениях. Их статья «За Азимовым» предлагает новые законы:

- Человек не может создать робота без рабочей системы «человек-робот», отвечающей самым высоким юридическим и профессиональным стандартам безопасности и этики. Каким бы умным ни был робот, это продукт, а не человек. Производители и люди, внедряющие его, должны нести ответственность за его действия.

- Робот должен отвечать людям в зависимости от их роли. Необдуманные инструкции могут вызвать хаос, не нарушая ни одного из трех законов. В одном из интервью Азимов подправил свою формулировку. «Робот должен выполнять приказы, данные ему квалифицированным персоналом». Слепое подчинение не желательно.

- Робот обязан соблюдать достаточную автономию для защиты своего существования, если такая защита обеспечивает плавную передачу контроля другим агентам в соответствии с Первым и Вторым законами. Независимо от обстоятельств, люди всегда должны быть в состоянии взять верх, если они чувствуют в этом необходимость.

Исаак Азимов — один из самых знаменитых писателей-фантастов, и, пожалуй, его самое известное творение — «Три закона робототехники». Хотя законы Азимова влияли на разработчиков робототехники на протяжении десятилетий, сейчас настало время пересмотреть их эффективность и начать обсуждение нового набора законов, которые хорошо сочетаются с непрекращающимися, внушающими страх прорывами в робототехнике и технологии искусственного интеллекта во всем мире.